记者|郜阳

Sora,新型视频生成模型,它可以根据简短的文字提示(prompt),将其转化为长达一分钟的高清视频,镜头感堪比电影。

未来,各种Sora视频或将现身并“占领”视频社交平台,其对现实的影响与改变,可谓巨大。

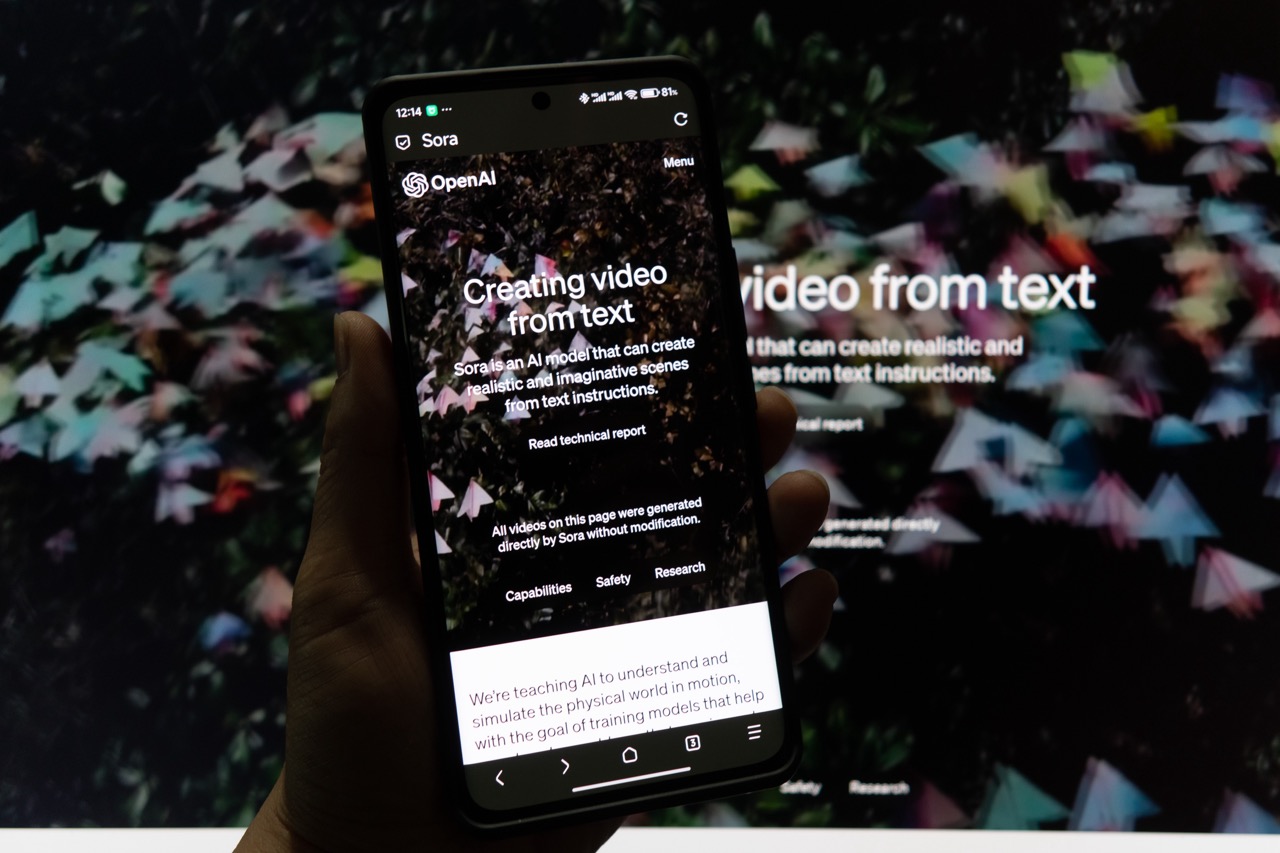

OpenAI发布首个视频生成模型Sora。 (图/Newscom)

AI视频要“变天”了

Sora“逆天”在哪儿?它不仅能够根据文字指令创造出既逼真又充满想象力的场景,而且生成长达1分钟的超长视频,还是一镜到底那种。

从发布的视频来看,60秒的视频中,视频主体与背景保持了高度流畅性与稳定性;在一个视频里实现多角度镜头,分镜切换符合逻辑且十分流畅;此外,Sora对于光影反射、运动方式、镜头移动等细节处理非常到位。

Sora的视频效果,几乎和人工拍摄不相上下,由此带来的强大冲击让无数人感叹,“现实,不存在了”。

OpenAI究竟是怎么做到的?

总体而言,Sora是一个在不同时长、分辨率和宽高比的视频及图像上训练而成的扩散模型,同时采用了Transformer架构。展开讲,在视觉数据上,OpenAI把视频和图像分解为较小的数据单元Patches(补片),每个patches相当于GPT中的一个token(词元);在语言理解能力上,采用了DALL·E 3的重标注技术,通过为视觉训练数据生成详细描述的标题,使模型更加准确地遵循用户的文本指令生成视频。另外,Sora还能将现有的静态图像转化成视频,精准赋予图像中内容以生动的动作;模型还能扩展现有视频或补全缺失的帧。

据悉,OpenAI目前没有向公众发布Sora的计划,但将首次开始与第三方安全测试人员共享该模型。

Sora 是由OpenAI 开发的首个文生视频(Creating video from text)模型。(图 /Newscom)

对相关行业具颠覆性

英伟达人工智能研究院首席研究科学家Jim Fan认为,Sora是一个数据驱动的物理引擎,称这是视频生成领域的GPT-3时刻,“回到2020年,GPT-3不是一个很完美的模型,但是它有力证明了上下文学习的重要性,所以不要纠结于GPT-3的缺陷,多想想后面的GPT-4。”

360创始人周鸿祎也发布微博,提到自己对Sora的看法。在他看来,Sora只是小试牛刀,它展现的不仅仅是一个视频制作能力,而是大模型对真实世界有了理解和模拟之后,会带来新的成果和突破。

周鸿祎写道:“这次OpenAI利用它的大语言模型优势,让Sora实现了对现实世界的理解和对世界的模拟两层能力,这样产生的视频才是真实的,才能跳出2D的范围模拟真实的物理世界。”他认为,AI不一定那么快颠覆所有行业,但它能激发更多人的创作力,“今天Sora可能给广告业、电影预告片、短视频行业带来巨大的颠覆,但它不一定那么快击败TikTok,更可能成为TikTok的创作工具。”

周鸿祎也直言,“一旦人工智能接上摄像头,把所有的电影都看一遍,把YouTube上和 TikTok 的视频都看一遍,对世界的理解将远远超过文字学习,一幅图胜过千言万语,这就离AGI真的不远了,不是10年、20年的问题,可能一两年很快就可以实现。”

OpenAI CEO山姆·奥特曼。(图/ Newscom)

警惕“潘多拉魔盒”

在Sora横空出世前,OpenAI 首席执行官山姆·奥特曼就曾表示,人工智能有望在推理能力和可靠性、多模态、可定制化和个性化三个领域大幅提升,并认为,至少在未来5到10年内,AI大模型技术将处于一个非常陡峭的成长曲线上。

值得关注的是,就在Sora发布的同日,谷歌也发布其大模型矩阵的最新力作——Gemini 1.5,其将稳定处理上下文的上限扩大至100万Tokens(词元),这代表它能一次处理大量的信息——包括1小时的视频、11小时的音频、超过3万行代码或超过70万字的代码库。

新事物,显然无法做到“完美”。OpenAI明确指出,Sora可能难以准确模拟复杂场景的物理原理,并且可能无法理解因果关系。这一模型还可能混淆提示的空间细节,并且可能难以精确描述随着时间推移发生的事件——而这些缺陷或将使Sora生成一些不合逻辑的东西。

据了解,OpenAI 内部仍在开展模型伦理侧的对抗性测试,比如错误信息、仇恨内容、偏见内容,至于色情暴力等,会在文本输入时就被拒绝。

近两日,也有人工智能业内人士向记者表示,从技术角度来看,Sora是非常重大的飞跃,但“硬币有两面”,它存在潜在的滥用可能,“在AI视频构建的世界中,‘眼见为实’行不通了,眼睛看到的东西或许无法作为判断依据。”

是“阿拉丁神灯”还是“潘多拉魔盒”,显然现在下结论为时过早。该业内人士同时表示,对于新技术的到来,需要社会足够的包容性;同时,在大规模推向社会前,务必做好应对风险的准备。

(本文获新民晚报授权转载,内容有删减,如需了解更多信息,请扫新民晚报官方微信二维码。)